26.04.2026 à 09:18

L’IA va-t-elle tuer la notion de création culturelle ?

Alain Busson, Professeur émérite ( Docteur ès Sciences Economiques), HEC Paris Business School

Texte intégral (2080 mots)

L’idéal des années 1960 s’est retourné en un paradoxe contemporain : plus la culture circule librement, moins les auteurs peuvent revendiquer la propriété de leurs œuvres. Le champ culturel a connu durant les quarante dernières années la révolution du numérique puis celle de l’intelligence artificielle générative. Le support physique est devenu quasiment obsolète, le fichier numérique de l’or. Retour historique sur les mutations des industries culturelles.

Le développement des industries culturelles au XXᵉ siècle s’est fondé sur la reproduction des œuvres d’art sur des supports physiques. Le premier facteur de changement s’est traduit par la substitution des technologies analogiques – ensemble de composants électroniques – par des technologies numériques pour le codage, le transport et le stockage des contenus.

Avec la numérisation, tout contenu, quelle qu’en soit la nature – texte, son, image fixe ou animée –, peut être codé sous la forme d’une suite de nombres et encapsulé dans un fichier informatique. Ce format d’encodage commun a favorisé le traitement algorithmique des données recueillies, ainsi que l’émergence de nouveaux acteurs dans les industries culturelles, comme Spotify, Deezer ou Netflix, ainsi que l’apparition de géants du numérique, comme Amazon ou Alphabet (Google), lorgnant sur l’assiette appétissante de leur voisin.

Les perdants : les auteurs et autrices, souvent privés de leur droit de propriété. Alors, qu’ont apporté ces révolutions aux industries culturelles ?

Du lieu physique au fichier numérique

Le point de bascule est la naissance en 1969 d’Arpanet, l’ancêtre d’Internet, avec la connexion de deux ordinateurs de l’université de Californie échangeant des informations. Une innovation majeure, non sur le plan technologique, mais sur le plan topologique.

Nous sommes passés d’une organisation pyramidale, centralisée et hiérarchique (comme le sont les organisations militaires), à une organisation décentralisée et non hiérarchique – horizontale, de pair-à-pair (peer-to-peer) –, caractéristique de la société post-industrielle. Cette innovation a entraîné une véritable révolution à la fois dans la circulation des contenus culturels, ainsi que dans leur mode de consommation et de légitimation.

À lire aussi : Débat : En France, le livre papier a-t-il encore un avenir ?

La première conséquence de ce phénomène est la globalisation et la déterritorialisation des industries culturelles. Alors que les industries traditionnelles dépendaient pour leur diffusion d’installations matérielles implantées localement – librairies, cinémas, disquaires ou grandes surfaces –, il est désormais techniquement possible d’envoyer n’importe quel contenu culturel – un fichier numérique – de n’importe quel endroit dans le monde à un autre. Par exemple, l’entreprise Amazon a été créée en 1994 autour de la vente en ligne de livres.

Ces phénomènes favorisent l’émergence de plateformes mondiales de diffusion numérique de contenus culturels. Si certains de ces acteurs se développent spécifiquement dans le domaine culturel – Netflix, Spotify –, les plus puissants d’entre eux ont un cœur de métier qui lui est étranger : les GAFA aux États-Unis – Google, Amazon, Facebook et Apple – ou leurs équivalents chinois BATX – Baidu, Alibaba, Tencent et Xiaomi.

Le pouvoir de marché et les ressources financières de ces derniers sont incomparables avec ceux des entreprises des industries culturelles traditionnelles.

Révolution du peer-to-peer

Une autre transformation radicale : l’affaire Napster qui a éclaté en 1999 en constitue le point de bascule. Service illégal de partage de fichiers musicaux en peer-to-peer, Napster a révélé que, dans un monde où règne l’abondance, où les fichiers peuvent être téléchargés rapidement et à coût quasiment nul, l’achat du support des œuvres qui était la norme dans le monde analogique est devenu inutile ; seule compte la capacité d’accès au catalogue, moyennant un forfait généralement assez bas.

Le développement du numérique s’est traduit par la remise en question des pouvoirs institutionnels – partis politiques, élus, etc. – et, dans le domaine qui nous intéresse, par le transfert du pouvoir aux consommateurs au détriment des intermédiaires traditionnels. Les instances de légitimation – académies, critiques littéraires et cinématographiques – dont le rôle est de produire des normes esthétiques – définir ce qui est « bon » et/ou « beau ») sont remises en question.

Plus de 106 000 titres mis en ligne chaque jour

Cette opposition a été considérablement renforcée par la puissance des réseaux sociaux. Ces derniers reposent sur une logique de communication peer-to-peer entre consommateurs échangeant leurs opinions et leurs jugements, même si, pour faire face au problème de l’hyperchoix, le consommateur peut recourir au jugement de nouveaux influenceurs ou aux recommandations des algorithmes.

La situation d’abondance, voire de surabondance, intégrée dans des offres d’accès (plateformes par abonnement), participe d’une banalisation des œuvres, auxquelles on accède selon les mêmes modalités que l’eau ou l’électricité. Un chiffre clé du rapport concerne la saturation de l’offre : plus de 106 000 nouveaux titres sont mis en ligne chaque jour sur les plateformes. Près de 20 % sont créés par l’IA générative.

Des choix dictés par les algorithmes

La révolution numérique est à l’origine de la première mutation civilisationnelle. L’intelligence artificielle en annonce la seconde.

Sans remonter à Alan Turing, on peut dater la naissance de l’intelligence artificielle (IA) à 1956 avec le Dartmouth Summer Research project on Artifical Intelligence. Il faudra attendre la croissance exponentielle des données disponibles (big data) et la croissance tout aussi importante de la puissance de calcul des microprocesseurs pour en constater l’efficacité. Les nouveaux modes de distribution des contenus culturels permettent en effet une connaissance sans précédent du comportement du consommateur.

À lire aussi : Débat : En France, le livre papier a-t-il encore un avenir ?

Les données recueillies, au-delà des questions relatives au respect de la vie privée ou du droit d’auteur, peuvent être exploitées de deux manières : en renforçant les choix routiniers des consommateurs grâce aux algorithmes de recommandation, mais également en concevant des contenus basés sur l’anticipation de leurs réactions. Sur Netflix, près de 80 % des contenus sont suggérés par son algorithme.

Plus radicalement, le développement des techniques d’intelligence artificielle générative peut conduire à un changement de paradigme en mettant à bas le modèle romantique de l’autonomie de l’artiste. De Van Gogh, peintre maudit (de son vivant), au génie Mozart, l’artiste créait uniquement selon sa propre inspiration, quelle que soit la réaction de son public ou de ses mécènes. Avec l’IA générative, la technologie supplante l’artiste (totalement ou partiellement) dans l’acte de création.

L’économie de la culture avait longtemps été la loi de l’offre et de la demande. Chaque produit étant unique, c’est le règne du « Nobody knows » : personne n’a la recette du succès. L’aléa commercial est la norme, avec l’espoir que les profits engendrés par les rares succès compensent les pertes des nombreux échecs. Le rôle du producteur ou de l’éditeur avait un rôle (intuitif) de ce que peut accepter le marché, fondé sur leur expérience. Un modèle aujourd’hui battu en brèche par l’intelligence artificielle générative qui peut connaître les goûts des consommateurs grâce aux données.

La création au cœur de l’innovation technologique

Avec les algorithmes, le numérique est devenu le « principe organisateur du monde ». Il facilite les échanges, rend les êtres et les choses disponibles de façon immédiate et quasi illimitée. La technologie a perdu l’attribut qui lui était jusqu’alors réservé, celui de rendre, sous le contrôle de l’humain, la vie plus facile. Elle est devenue, comme le souligne la docteure en science politique Charleyne Biondi « une extension de soi » :

« La relation instrumentale de l’homme à son outil se transforme en relation organique dans laquelle il se crée une forme de réciprocité indissociable entre l’homme et la machine. »

Que devient notre libre arbitre quand nos choix sont dictés par des algorithmes qui se basent largement sur l’observation de nos propres routines ? Pouvons nous encore observer le monde lorsque sa représentation numérique, la carte (le GSP) est devenue plus importante pour nous orienter que le territoire qui est devant nos yeux ?

Dans le domaine culturel, le point de rupture n’est pas là. Avec l’émergence de l’intelligence artificielle et en particulier des IA génératives, c’est la création même qui est, pour la première fois dans l’histoire, au cœur de l’innovation technologique. Après avoir orienté les consommations et, par rebond, la nature des œuvres produites, elle touche à l’essence même de la production culturelle, c’est-à-dire l’acte créatif.

Processus de remplacement

L’IA générative commence à pénétrer toutes les étapes de la chaîne de valeur des industries culturelles et créatives, simplifiant les procédures et réduisant les coûts. Il est possible de pointer un double paradoxe :

la révolution numérique et ses derniers avatars, fondée à l’origine sur un désir d’émancipation, conduit à un monde, où, pour des raisons d’efficacité, la volonté humaine est peu à peu remplacée par celles des algorithmes.

Le partage libre proposé par la contre-culture libertaire des années 1960, où la connaissance, le code et la création doivent circuler librement avait conduit à une volonté d’abolir le droit d’auteur.

L’idéal des années 1960 s’est retourné en un paradoxe contemporain : plus la culture circule librement, moins les auteurs peuvent revendiquer la propriété de leurs œuvres et vivre de leur art.

Il est encore trop tôt pour savoir si ce processus de « remplacement » ira à son terme, ou si l’IA générative, du fait de la volonté de ses utilisateurs, restera cantonnée à un rôle de support plus ou moins imaginatif.

Alain Busson ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

26.04.2026 à 09:17

Enseigner la géopolitique par le jeu : quel intérêt pédagogique ?

David Moroz, Associate professor, EM Normandie

Sarah Alves, Enseignant chercheur en ressources humaines, EM Normandie

Texte intégral (1471 mots)

Peut-on apprendre la géopolitique en jouant aux Lego ? Une expérimentation menée auprès d’étudiants d’une école de management explore la piste de l’utilisation de la méthode Lego Serious Play pour enseigner cette discipline.

Les tensions et conflits géopolitiques occupent une place centrale dans notre société. Une pleine compréhension des mécanismes qui les sous-tendent est une nécessité pour les décideurs politiques et économiques, mais aussi pour les citoyens, en leur qualité d’électeurs comme de consommateurs. Y parvenir n’est cependant pas chose aisée, principalement pour deux raisons.

D’abord, l’apprentissage de la géopolitique oblige l’étudiant à mobiliser des connaissances issues d’une variété de domaines – histoire, économie, géographie ou encore relations internationales – qu’il a abordés séparément au fil de son parcours académique. Lorsque ces domaines se trouvent soudainement combinés dans un même cours, l’exercice peut devenir déroutant pour un étudiant habitué à raisonner par silos disciplinaires.

Ensuite, il faut intégrer le fait qu’un étudiant est aussi un jeune citoyen. Les questions géopolitiques – conflits, rivalités de puissance, tensions internationales – peuvent entrer en résonance avec les convictions politiques, idéologiques ou morales qu’il est encore en train de construire. Pour l’enseignant, l’exercice peut s’avérer délicat car il s’agit de former à des outils d’analyse objective là où l’étudiant peut être tenté de s’engager dans de vifs débats se réduisant à des oppositions sourdes de convictions.

Face à ces défis pédagogiques, de nombreux enseignants expérimentent des méthodes d’apprentissage plus actives, afin d’aider les étudiants à appréhender avec objectivité la complexité des situations géopolitiques. C’est dans cette perspective que nous avons mené une expérimentation originale dans le cadre de nos cours de géopolitique, en utilisant la méthode Lego Serious Play, une méthode de résolution de problèmes en 3D reposant sur la manipulation des fameuses briques danoises.

Construire des enjeux géopolitiques avec des briques

Le principe de la méthode Lego Serious Play consiste à faire faire, par l’ensemble des participants d’un atelier Lego, des constructions en briques Lego pour représenter leurs idées, puis à leur faire expliquer la signification de leurs constructions aux autres participants. L’approche favorise ainsi une forme d’écoute, de respect et d’approche collaborative de résolution de problèmes.

L’enseignement de la géopolitique nous a semblé être un domaine particulièrement adapté à cette méthode. En effet, comprendre une situation géopolitique implique d’identifier une diversité d’acteurs, de territoires, de ressources ou de représentations et, surtout, de comprendre comment ces variables interagissent entre elles et en considérant une hétérogénéité d’échelles d’analyse.

Forts de ce constat, nous avons supposé que permettre aux étudiants de construire physiquement un paysage géopolitique pouvait les aider à mieux appréhender ces interactions.

Pour tester cette approche, nous avons mené une expérimentation auprès de 139 étudiants de troisième année d’une école de management. Tous suivaient un cours de géopolitique identique en termes d’objectifs pédagogiques, de cas étudiés et de durée.

Les étudiants ont été répartis en deux groupes. Dans le premier, des étudiants ont étudié des problématiques géopolitiques en participant à un atelier Lego Serious Play. Dans le second, le groupe témoin, les étudiants ont analysé les mêmes problématiques mais sans recours à la méthode.

À la fin du cours, nous avons évalué deux dimensions, à savoir, d’une part, l’expérience vécue par les étudiants lors des ateliers et, d’autre part, leur compréhension des concepts de l’analyse géopolitique.

Des étudiants engagés dans l’activité

Un premier constat : les ateliers Lego Serious Play suscitent un fort engagement des étudiants. Les participants ont déclaré être fortement immergés dans l’activité et avoir éprouvé un sentiment de contrôle et de bien-être pendant l’atelier.

Autrement dit, l’expérience a été perçue comme stimulante, plaisante et motivante.

Ces résultats corroborent les résultats de recherches antérieures ayant montré que les méthodes pédagogiques fondées sur le jeu, la manipulation d’objets peuvent favoriser l’engagement des apprenants et rendre l’apprentissage plus agréable.

En revanche, lorsque nous comparons les résultats des étudiants des deux groupes sur des tests de connaissances, nous observons que les étudiants ayant participé aux ateliers n’obtiennent pas systématiquement de meilleurs scores que ceux du groupe témoin. Si les étudiants ayant participé aux ateliers semblent cependant mieux comprendre certaines dimensions de l’analyse géopolitique, notamment les représentations subjectives, culturelles des acteurs géopolitiques, sur d’autres dimensions, les résultats sont légèrement inférieurs.

Autre observation intéressante : la distribution des résultats est plus dispersée dans le groupe ayant expérimenté la méthode. Certains étudiants obtiennent de très bons résultats, tandis que d’autres rencontrent davantage de difficultés.

Le résultat peut sembler paradoxal. En effet, comment une activité perçue comme engageante peut-elle produire des effets aussi nuancés sur l’apprentissage ?

Le rôle de l’« effet waouh » dans l’apprentissage

Une piste d’explication tient à la manière dont la méthode a été utilisée dans cette expérimentation. En l’occurrence, la méthode Lego Serious Play peut mobiliser jusqu’à six techniques différentes de construction. Dans notre expérimentation, seules trois d’entre elles ont pu être mises en œuvre, en raison de contraintes logistiques.

Les techniques qui n’ont pas été employées dans l’expérimentation auraient peut-être pu jouer un rôle critique dans la compréhension des dynamiques de situations complexes, car elles consistent à construire des connexions, des systèmes et à simuler des scénarios en faisant bouger les constructions selon un protocole défini.

Dans notre expérimentation, les étudiants ont construit ce que l’on peut nommer des « paysages géopolitiques », mais pas des systèmes géopolitiques. Autrement dit, ils ont construit les différentes variables d’une situation géopolitique mais pas les interactions entre celles-ci et surtout, ils n’ont pas fait bouger ces variables en faisant bouger les briques une fois des connexions construites entre elles.

Cette limitation pourrait expliquer l’absence de ce que les praticiens de la méthode décrivent parfois comme un « effet waouh », un moment où la visualisation d’un système complexe de briques en mouvement provoque une prise de conscience par une forme d’émerveillement, une émotion spécifique liée au fait de voir les briques et les constructions s’animer.

Ce que nous apprend cette expérimentation

Cette expérimentation ne permet pas de tirer des conclusions définitives sur l’intérêt de la méthode Lego Serious Play en tant qu’outil pédagogique. Notre échantillon reste relativement limité et d’autres recherches sont nécessaires pour mieux comprendre les effets pédagogiques de la méthode, les travaux sur le sujet demeurant encore en nombre limité.

Cela étant dit, notre expérimentation nous a permis d’observer l’intérêt de la méthode Lego Serious Play, même partiellement appliquée, pour analyser la complexité de situations géopolitiques. Nos résultats nous invitent à supposer que la méthode doit être employée dans son intégralité pour permettre à des étudiants de comprendre les dynamiques systémiques caractérisant les relations géopolitiques.

À l’heure où les enjeux géopolitiques occupent une place centrale dans le débat économique, social et politique, identifier des moyens efficaces d’enseigner la géopolitique à nos futurs – voire actuels – décideurs constitue plus que jamais un défi majeur pour l’enseignement.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

26.04.2026 à 09:17

Pourquoi évaluer l’efficacité des aires protégées est plus difficile qu’il n’y paraît

Paul Rouveyrol, Ecologue, expert en évaluation des politiques d'aires protégées, Muséum national d’histoire naturelle (MNHN)

Texte intégral (2797 mots)

Il ne suffit pas de créer des aires protégées : encore faut-il s’assurer qu’elles ont un effet positif sur la biodiversité. Comment réaliser ce suivi ? Les difficultés sont d’ordre méthodologique : comment avoir la certitude que ce que l’on observe est bien, et seulement, lié à la création de l’aire protégée ? Et comment pallier l’absence de données de suivi plusieurs décennies en arrière ? Éléments de réponse.

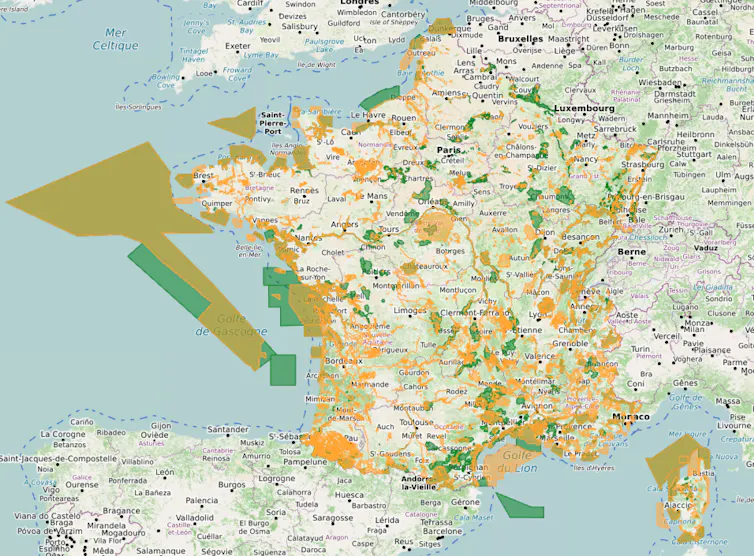

Dès 2020, la France s’est engagée au niveau international à couvrir 30 % de son territoire par des aires protégées, ce qui était l’un des objectifs fixés par les négociations internationales sur la biodiversité. Aujourd’hui, le chiffre visé est atteint : les aires protégées représentaient, en 2025, 33,5 % du territoire terrestre et maritime français.

Cependant, au-delà de la surface couverte, les textes internationaux demandent explicitement que ces aires soient « effectivement conservées et gérées », comprendre : que les aires protégées le soient réellement. En effet, désigner un espace ne suffit pas pour garantir qu’il produise des effets positifs sur la biodiversité.

Mais comment évaluer l’efficacité des aires protégées ? Intuitivement, on pourrait être tenté de comparer l’état des écosystèmes entre l’intérieur des aires protégées et le reste du territoire. Si les aires protégées sont « efficaces », alors on peut s’attendre à ce que cet état soit meilleur en leur sein.

Le problème, c’est qu’on peut certes considérer qu’une aire protégée n’est efficace que si cette différence existe, mais que la réciproque n’est pas vraie : les aires protégées ne sont jamais disposées au hasard. Des méthodes statistiques s’appuyant sur le suivi dans le temps de zones protégées et non protégées (sites témoins) permettent de s’affranchir de cette limite, mais ne sont pas parfaites pour autant. Il est donc urgent de multiplier les approches pour garantir la robustesse du suivi.

Quand comparer avec les zones non protégées ne suffit pas

Comparer l’intérieur et l’extérieur des aires protégées est nécessaire mais non suffisant. Cela peut paraître paradoxal, mais il y a plusieurs explications à cela :

- d’une part, les aires protégées sont généralement créées pour permettre la conservation d’un patrimoine naturel jugé remarquable, doté par conséquent d’une biodiversité plus riche ou abritant plus d’espèces rares que le reste du territoire. Il est donc logique que, dès leur création, et avant même qu’elles aient produit un effet, les écosystèmes s’y portent mieux qu’ailleurs.

- D’autre part, la création d’une aire protégée génère souvent des conflits avec certaines catégories d’acteurs, notamment économiques, qui s’attendent à ce que leurs activités y soient contraintes. Ces difficultés d’acceptabilité se traduisent par un évitement, lors de la mise en place des aires protégées, des zones à fort niveau d’activités humaines. Il a été démontré que les aires protégées étaient davantage présentes dans les secteurs reculés, ou peu peuplés, comme les régions montagneuses.

Ce second biais se traduit également par une biodiversité moins dégradée au sein des aires protégées dès leur création, renforçant la difficulté à tirer des conclusions d’une simple comparaison dedans/dehors.

À lire aussi : Pour préserver la biodiversité, ne délaissons pas les aires non protégées

Ce que l’évolution des milieux dit de l’efficacité des aires protégées

Comment s’affranchir des biais liés à la localisation des aires protégées pour évaluer leur efficacité ? En sciences expérimentales, cette difficulté se traite avec un dispositif spécifique, appelé BACI, acronyme de Before After Control Impact (soit en français : « avant après témoin traité »).

Le principe est simple : il s’agit non pas de comparer l’état actuel d’un site protégé avec celui d’un site non protégé, mais de suivre l’évolution dans le temps de chacun de ces deux sites, et ce, depuis la création de l’aire protégée.

Ainsi, un site protégé sera considéré comme « efficace » si son évolution depuis sa création est plus favorable que celle du site non protégé, dit « témoin ». Comme il n’y aurait pas de sens à comparer, par exemple, une aire protégée forestière avec un site témoin en plaine céréalière, on fait également en sorte que l’aire protégée suivie et la zone témoin soient aussi similaires que possible. L’objectif est de limiter l’incidence de facteurs d’influence autres que la création et la gestion de l’aire protégée.

En appliquant ce modèle au réseau Natura 2000 en France, il a pu être montré que l’évolution des populations d’oiseaux communs des milieux agricoles était plus favorable dans le réseau qu’au-dehors.

Nous savions déjà, grâce à une précédente étude, que ces populations étaient plus abondantes dans le réseau. Comme expliqué précédemment, cela montrait surtout que les sites Natura 2000 avaient été placés sur des territoires plus riches en oiseaux que la moyenne. Cela constitue d’ailleurs une condition préalable essentielle à ce que ces sites puissent jouer un rôle pour la conservation de ces espèces.

Il est intéressant de remarquer que l’étude mobilisant l’approche BACI pour le réseau Natura 2000 ne concluait pas que les populations d’oiseaux liés aux milieux agricoles augmentaient au sein des sites labellisés Natura 2000. C’est uniquement en comparant avec le reste du territoire, où la chute de ces mêmes populations était vertigineuse sur la période, que l’analyse a permis de conclure à une « efficacité » des sites Natura 2000.

À lire aussi : Protection de la biodiversité : retour sur l’évolution des « aires protégées » dans le monde

Savoir croiser les sources et prendre de la hauteur sur les chiffres

Pour autant, même lorsqu’il mobilise le BACI, ce type d’étude n’est pas exempt de limites. Souvent, on ne dispose pas de données remontant suffisamment loin dans le temps pour bien décrire l’évolution de la biodiversité. Même les données utilisées pour choisir les sites « témoins », qui doivent être similaires aux sites protégés au moment de leur création, sont trop parcellaires et manquent de précision.

Or, les aires protégées françaises sont, pour la plupart, très anciennes. Elles existent souvent depuis plusieurs décennies, parfois une centaine d’années, ce qui complique encore la donne.

Dans ces conditions, on peine à constituer un vrai BACI :

d’abord parce que l’image « avant » ne remonte que rarement à la date de création de la zone protégée et ne s’affranchit donc pas complètement des biais de localisation,

mais aussi parce que le « témoin » n’est que vaguement semblable à l’aire protégée, et cela, à une époque trop récente, pas nécessairement lors de sa création.

Ces difficultés sont difficiles à surmonter. Dans la plupart des cas, l’absence de données historiques environnementales ne peut pas être compensée.

À lire aussi : Les sites « naturels » classés : dépasser l’idée d'une nature musée ?

Ces résultats imparfaits sont-ils pour autant inutiles ? Non. Certes, ils doivent être interprétés avec prudence, mais ils livrent des informations précieuses, par exemple sur un effet plus marqué dans un type de milieu naturel ou d’espace protégé. Ainsi, l’effet de Natura 2000 démontré sur les oiseaux liés aux milieux agricoles n’a pas été observé sur les espèces forestières, ce qui peut indiquer un effort de gestion insuffisant sur ces milieux.

Ils ne constituent donc qu’une partie de l’évaluation et peuvent être utilement complétés avec d’autres approches, notamment qualitatives. Toujours au sein du réseau Natura 2000, de façon contre-intuitive, il a ainsi été mesuré que plus les sites étaient initialement soumis à des pressions humaines susceptibles de les dégrader, moins les moyens mis en place concernant ces pressions étaient importants.

Ce résultat ne présage pas entièrement de l’effet de la politique, mais il donne une information sur ce qui pourrait expliquer qu’il ne soit pas aussi important qu’attendu. Au-delà de la question de l’effet produit, on peut ainsi vérifier la pertinence des efforts de gestion menés dans les aires protégées.

Évaluer l’efficacité des aires protégées est donc difficile. Cet exercice doit composer avec toute la complexité des écosystèmes, mais également celle des sociétés avec lesquelles ils interagissent. Il s’agit pourtant d’un travail indispensable.

Plutôt que de se baser sur un modèle unique, forcément limité, il y aurait tout à gagner à multiplier les approches, les questions, les données et les disciplines scientifiques. C’est en construisant un faisceau d’indices en croisant les sources qu’on peut dessiner l’image la plus juste, mais aussi la plus utile, de l’effet qu’ont les aires protégées sur la biodiversité.

Paul Rouveyrol ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time [Fr]

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview